Precios excesivos y nombres falsos son las mayores razones, y muchos incentivan que AMD pueda ofrecer una competencia fuerte. (NVIDIA)

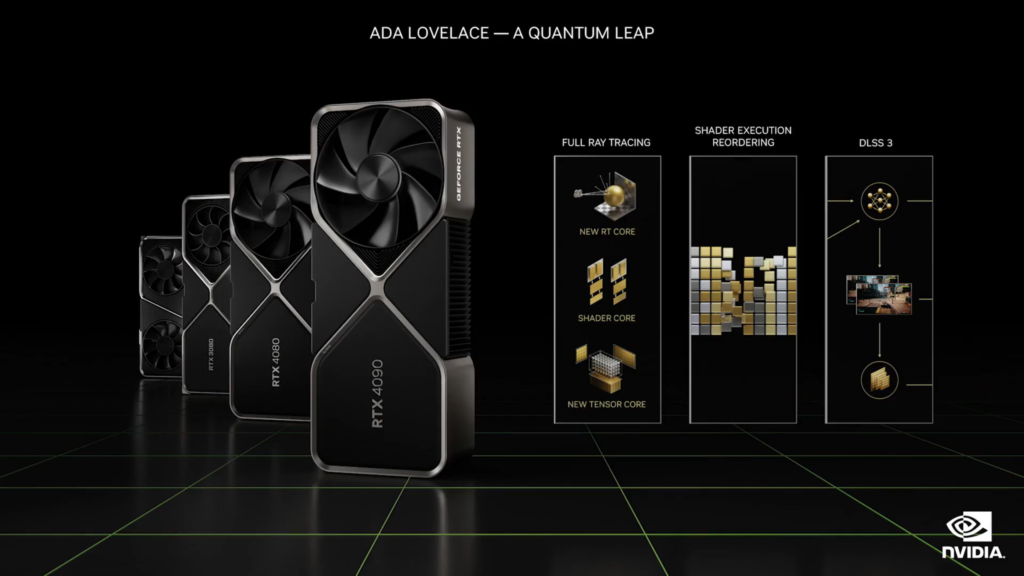

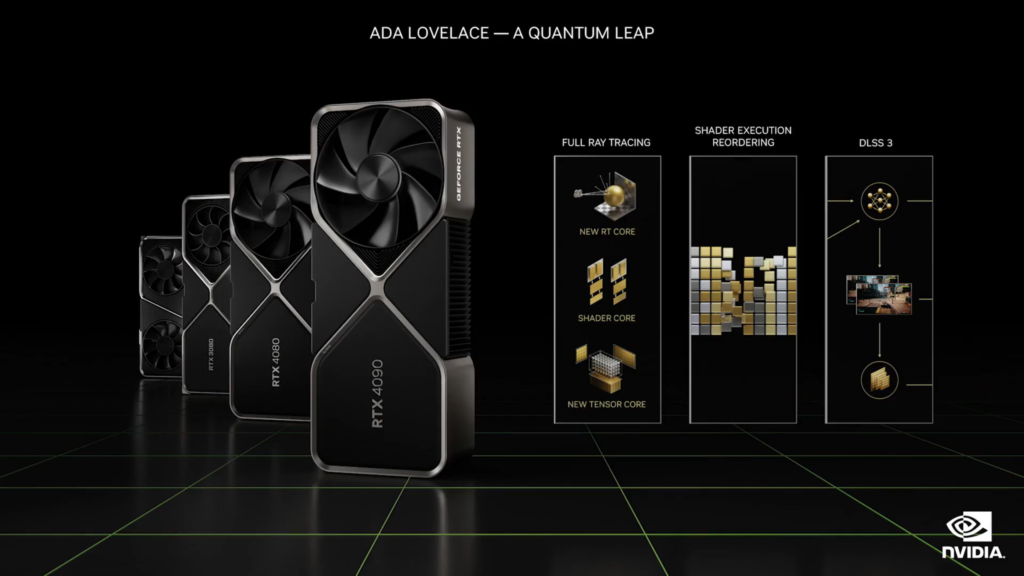

Estamos a dos años del lanzamiento de la serie 30 de GPUs de NVIDIA, y como cualquier relativo PC Gamer te dirá, eso quiere decir por default que se aproxima la nueva generación. Y, como era de esperarse, recibimos los primeros detalles el 20 de septiembre, con la revelación de la RTX 4090, RTX 4080 16 GB y RTX 4080 12 GB, con la primera lanzándose el 12 de octubre, y las otras en alguna fecha de noviembre.

Esas son las partes básicas, pero más de un par de detalles o aspectos que deliberadamente no fueron explícitos enojaron a los PC Gamers, al punto que esperan que AMD ofrezca una competencia lo suficientemente poderosa para que equipo verde replantee su estrategia.

NVIDIA confirmó que los precios de la RTX 4090, 4080 16 GB y 4080 12 GB serán de un MSRP de 1600 dólares, 1200 dólares y 900 dólares, respectivamente. Si comparamos con el precio original de la 3090 a 1500, el salto no parece malo.

Sí, son 100 dólares más, pero basándose en las especificaciones del GPU, el salto de rendimiento sobrecompensará grandemente por ese mayor costo, más si lo comparamos con que parece ser notablemente superior a la 3090ti, la cual originalmente se puso al precio excesivo de 2000 dólares.

Por ende, la 4090 es probablemente la tarjeta menos controversial del anuncio, irónicamente. Sigue siendo una GPU hecha estrictamente para los gamers entusiastas (y de ninguna manera hecha para el mercado argentino). 1600 dólares es una cantidad insana de dinero para la gran mayoría de consumidores. Pero para aquellos consumidores de la 3090 y más la 3090ti, estos precios no deberían parecerles mucho peores.

El verdadero problema llega con las dos “3080”, cuando en realidad deberían llamarse de forma distinta. El modelo de 16 GB, según estimado por canales como Hardware Unboxed, ofrece un decente salto de rendimiento comparado con la 3090 ti (aunque notablemente inferior a la 4090), con 9.728 núcleos CUDA, 76 núcleos de Ray Tracing y 736 GBs por segundo de ancho de banda de memoria.

Sin embargo, el precio sigue siendo muy alto. Pasar de 700 dólares de la 3080 a MSRP a 1200 es casi un salto de 50% de precio. Pero ey, para eso está el modelo de 12 GB ¿no? Después de todo, 12 de VRAM hoy es bastante aceptable para gaming en alta gama, y 900 dólares no es un salto tan grande de 700.

Bueno, acá entra lo deliberadamente oculto, porque, basándonos en el nombramiento, el modelo de 12 GB debería ser exactamente idéntico al de 16 salvo la menor cantidad de VRAM, pero no es así, lejos de ello.

Al revisar las especificaciones de la RTX 4080 12 GB, más allá de la menor memoria, también posee 7.680 núcleos CUDA, 60 núcleos de Ray Tracing y un ancho de banda de memoria de 504 GBs por segundo.

Ahora, como pueden ver, estas especificaciones varían una decente cantidad del modelo de 16 GB, y, para los no familiarizados, esto no debería ser así. Después de todo, el extenso nombramiento de los GPUs de NVIDIA se presta a que esta placa de pueda nombrar como una RTX 4070 por sus especificaciones, o 4070ti en el mejor caso.

Entonces, ¿por qué no lo hicieron? Bueno, considerando que la 3070 en 2020 tuvo un precio de lanzamiento de 500 dólares, pasar de eso a 900 no deja a esta GPU en el mejor ojo público. Y la razón por el aumento de precios en general es que, dada la minería de tarjetas gráficas en 2020 hasta 2022, agregado a falta de disponibilidad, muchos gamers optaron por comprar estos componentes a precios ridículos que excedían con mucha diferencia su precio original.

Por ende, NVIDIA, sabiendo que los gamers podrían gastar esa cantidad ridícula de dinero, aumentó los precios de la subserie 70 y 80. Pero al mismo tiempo, sabían que hacerlo explícitamente no daría una gran imagen, así que disfrazaron estas 2 GPUs claramente distintas como 4080, como una forma de engañar al consumidor casual.

Esto sin mencionar que, incluso si descontamos todo esto, las especificaciones del modelo de 12 GB no son tan excelentes. Basándome en lo estimado por Hardware Unboxed, sería un poco menor o alrededor de la 3090, que suena genial para el no familiarizado. Pero para los que sepan, los modelos 70 en teoría deberían tener un poder equivalente al modelo más poderoso de la anterior generación. En el caso de la 3070, era similar a la 2080ti, pero acá, la 4080 12 GB (una 4070 disfrazada) solo es comparable a la 3090, la cual ni siquiera es la más poderosa de la anterior generación (3090ti).

Y luego, tenemos DLSS 3.0, una tecnología muy aclamada por los gamers que funciona como una especie de escalado avanzado. Así que hace que títulos seleccionados den la impresión de correr a una resolución superior. Mientras que simultáneamente tienen el rendimiento de una imagen de calidad mucho menor.

Por ejemplo, podemos tener un título que corre a 1440p con DLSS, que no nos da una imagen nativa. Pero si usamos los modos “calidad” o “ultra calidad”. Nos dará una calidad muy similar a la nativa para el ojo humano, mientras que tenemos framerates superiores.

Empezó de forma muy experimental, pero con DLSS 2.0 se volvió un método más que efectivo. Esto para correr títulos modernos en placas que quizás no tengan el poder suficiente. Aunque, cabe aclarar que esta tecnología es exclusiva de las tarjetas RTX, o sea, de serie 20 para adelante.

Bueno, ahora recibimos noticias muy buenas de NVIDIA, agregado de muy malas. Se nos confirmó DLSS 3.0, y aparenta tener muchas mejoras con respecto a su predecesora, dando más vida a las GPUs que soporta. Pero ahí entra el problema, porque equipo verde confirmó que DLSS 3.0 solo se aplicará a la serie 40.

Ahora, aclararon que se debe a ciertas limitaciones tecnológicas, pero varios expertos refutaron que la serie 30 es mas que capaz de manejar estas mejoras, por lo que estiman que este es otro movimiento de la compañía para motivarte a comprar la nueva generación.

Aun así, entre esto, los precios y marketing muy cuestionable, muchos fanáticos están comenzando a mirar por el otro lado.

Similar a NVIDIA, AMD por años lanzó tarjetas gráficas hechas para competir con equipo verde. Sin embargo, a pesar de su vasta experiencia, nunca llegaron a un punto que verdaderamente superaron a su competencia.

No obstante, AMD encontró su audiencia particularmente con los gamers de gama baja e incluso media gracias a su repertorio extenso y sólido, tales como la RX 570 de 2017 o la RX 6600 de 2021. Aunque, cuando intentaron cubrir la gama baja y entusiasta, tropezaron y muy fuerte en ocasiones, como cuando lanzaron la desastrosa Radeon VII en 2019 o las mejorables Vega en 2017.

Pero, de ser así, ¿Por qué los gamers, incluyendo los de gama alta quieren que AMD tenga la ventaja? Bueno, simplemente: competencia. Antes de que AMD introdujera su línea Ryzen de CPUs, Intel tenía básicamente el monopolio, y por años siguieron con su diseño repetitivo de 2 núcleos y 4 hilos con sus I3, 4 núcleos e hilos con I5, y 4 núcleos con 8 hilos con sus I7.

Así que, cuando Ryzen ofreció procesadores más revolucionarios en cantidad de núcleos a precios competitivos y económicos, Intel fue forzada a cambia. Con la décima generación, los I3 tendrían 4 núcleos y 8 hilos, con los I7 con 8 núcleos y 16 hilos. Fue con Alder Lake que superaron a Ryzen, con la división de núcleos de rendimiento y de eficiencia.

Y es gracias a esto que ambas compañías están cabeza a cabeza, y que recibimos mejores productos debido a que siguen tratando de superarse entre ellas. Y, a comparación, nunca tuvimos realmente algo parecido con NVIDIA, al menos en la gama alta y entusiasta. Es por esto que los gamers esperan que AMD ofrezca productos poderosos y a la vez competitivos el 3 de noviembre, de tal manera que obliguen a que NVIDIA mejore sus ofertas.

Miren, esto no es decir que NVIDIA no ofrece GPUs de calidad porque sus productos suelen ser sólidos, no por nada suelen ser la elección principal para los gamers. Sin embargo, es justamente esta dependencia que provocan movimientos anti-consumidor como las demostradas recientemente. Sin mencionar otros como su apoyo a la minería o el fin de su colaboración con EVGA.

La serie 40 no empezó con las mejores impresiones. Así que esperemos que las nuevas generaciones de AMD e Intel finalmente incentive verdadera competencia en el mercado de tarjetas gráficas.

Escrito por Ignacio Magnacco

Más notas de #Gaming en Tiempo Libre